Est-ce que l’effet ELISA nous guette toutes et tous ?

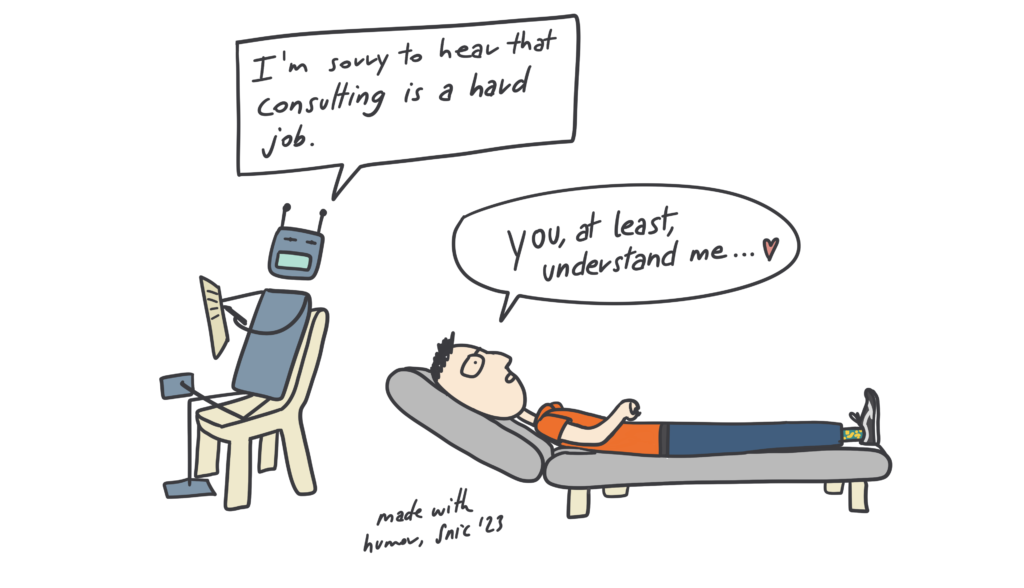

Dans le domaine informatique, cela désigne la tendance à assimiler de manière inconsciente le comportement d’un ordinateur à celui d’un être humain, on parle d’anthropomorphisme. (source wikipedia). Le simple fait d’illustrer un chatbot ou une IA sous cette forme c’est déjà de l’anthropomorphisme 😊

À l’époque (1966) Joseph Weizenbaum, créer un chabot (ELIZA) qui pose des questions et reformule à la manière d’un psychothérapeute rogérien. Il souligne dans son article comme il est facile de créer et maintenir une illusion de compréhension, qui peut donc affecter peut-être notre jugement sur sa crédibilité (lien)

Grâce aux derniers développements des ingénieurs d’OpenAI, dont entres autres le ton très sophistiqué et conversationnel, j’ai l’impression qu’on est passé encore à la vitesse supérieure et qu’on n’a pas fini de lutter avec notre instinct. Ça m’a denouveau fait le coup cette semaine lors de notre formation sur l’intelligence artificielle dans le processus d’innovation (merci Raffael Stöckli et Simeon Rudin !) : j’étais souvent à deux doigts d’écrire des « merci » et « s’il te plait » au milieu des prompts. En bref, une lutte contre 43 ans d’éducation 🤣

Ça ouvre beaucoup de question philosophique, dont par exemple : est-ce qu’en étant poli avec l’IA on fait inconsciemment de l’anthropomorphisme ? Certains le font par habitude, d’autres pensent que les résultats sont meilleurs (je vais essayer avec mon grille-pain et je vous redis 😉). Certains pensent (ou rigole à moitié) qu’un jour ChatGPT sera conscient et se souviendra de qui a été gentil avec lui ou elle… 🤦♂️

Pour moi c’est un outil et basta, et vous ?

Et bien sûr toujours à dispo pour illustrer vos stratégies, vos présentations, communications avec ou sans humour 😉